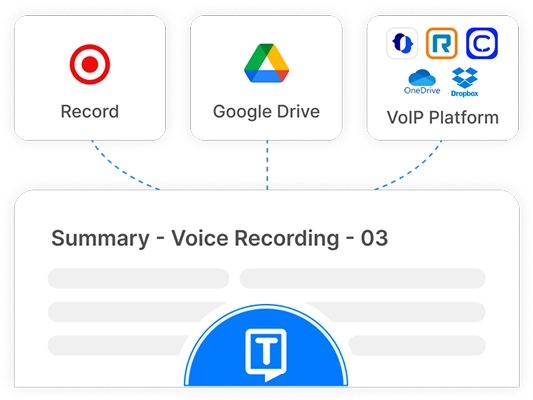

Créez votre compte et enregistrez ou téléchargez un fichier

Créez votre compte Transkriptor et commencez avec un accès gratuit à la transcription. Enregistrez ou téléchargez votre audio/vidéo pour commencer à transcrire instantanément.

Téléchargez pour convertir l'audio ou la vidéo en texte

Transcrire un fichier MP3Cliquez pour télécharger et transcrire gratuitement

Enregistrez de l'audio ou de la vidéo et transcrivez gratuitement

Fiable par des individus chez

Convertir audio en texte avec l'extension Chrome transcription la mieux notée. Enregistrez instantanément votre écran, caméra ou microphone et obtenez des transcriptions précises de la parole en texte depuis votre navigateur.

Transkriptor est reconnu comme l'une des meilleures solutions de logiciel de transcription audio, approuvé par des milliers d'utilisateurs dans le monde entier. Découvrez pourquoi les gens nous choisissent comme leur meilleur outil de transcription audio.

J'utilise Transkriptor depuis des mois et la précision est constamment de 98-99 %, même avec des termes techniques. Il prend en charge plusieurs langues, dont l'anglais, le suédois et l'allemand. Convertir de longs enregistrements en texte est désormais beaucoup plus rapide et efficace.

Lena Kaur

Spécialiste du marketing numérique

Apprendre à transcrire l'audio en texte est simple avec Transkriptor. Suivez notre processus étape par étape pour convertir n'importe quel enregistrement tel que des réunions, des conférences, des interviews ou des notes vocales en texte précis et éditable en quelques secondes.

Vous cherchez à transcrire de l'audio en texte pour votre secteur ? Transkriptor propose des fonctionnalités de transcription spécifiques aux secteurs, conçues pour les équipes juridiques, les prestataires de soins de santé, les psychologues, les consultants, les gestionnaires informatiques et les professionnels des médias.

Transformez chaque réunion en insights exploitables grâce à la transcription, aux résumés et aux analyses alimentés par l'IA.

Transkriptor accorde la priorité à la sécurité et à la confidentialité à tous les niveaux. Notre plateforme de transcription de niveau entreprise est conforme aux normes SOC 2, GDPR, ISO 27001 et SSL pour garantir que vos données audio et vidéo sont entièrement protégées et transcrites en toute sécurité.

Le meilleur convertisseur audio en texte est Transkriptor. Il utilise une IA avancée pour convertir avec précision l'audio parlé en texte écrit en quelques secondes. Transkriptor prend en charge les formats audio populaires tels que MP3, WAV et M4A, et fonctionne dans plus de 100 langues.

Le meilleur outil de transcription gratuit est Transkriptor. Il fournit des services de transcription vocale précis et alimentés par l'IA, même sur son plan gratuit. Avec l'option de transcription gratuite de Transkriptor, vous pouvez transcrire jusqu'à 30 minutes d'audio par jour.

La conversion vidéo en texte est le processus qui consiste à transformer automatiquement les mots parlés dans une vidéo en texte écrit à l'aide de la technologie de reconnaissance vocale alimentée par l'IA.

Transkriptor est l'un des meilleurs outils pour transcrire une vidéo en texte, offrant un traitement rapide, une grande précision et un support pour plusieurs langues et formats.

Oui, vous pouvez convertir automatiquement une vidéo en texte en utilisant des outils de transcription basés sur l'IA comme Transkriptor, éliminant ainsi le besoin de saisie manuelle.

Oui, convertir une vidéo en texte améliore le SEO en rendant le contenu vidéo consultable, indexable et accessible aux moteurs de recherche.

Les outils de conversion vidéo en texte sont idéaux pour les créateurs de contenu, les éducateurs, les journalistes, les marketeurs, les étudiants et les entreprises ayant besoin d'une transcription rapide.

Oui, la conversion vidéo en texte améliore l'accessibilité en fournissant des transcriptions lisibles pour les utilisateurs malentendants et un public plus large.

L'IA analyse les modèles de discours, les signaux audio et le contexte linguistique pour convertir avec précision les mots parlés d'une vidéo en texte.

Transkriptor propose une transcription vidéo en texte rapide, précise, sécurisée et abordable grâce à une IA puissante et des outils conviviaux.